在当今人工智能迅猛发展的时代,AI大模型与小模型已经成为研究和应用中的热门话题。虽然他们都属于同一领域,但在性质、应用场景和技术实现等方面存在明显的区别。本文将为您详细介绍这两种模型之间的十大主要区别,以帮助您更好地理解它们的特点和使用场景。

AI大模型通常指参数量极大的模型,如GPT-3、BERT等,拥有数以亿计的参数,计算能力和存储需求也相对较高。而小模型则是参数较少,通常在百万级别,设计上更加轻量,适合在边缘设备上部署。

大模型的训练需要海量的数据和强大的计算资源,通常依赖于高性能的图形处理单元(GPU)集群进行训练。相比之下,小模型在数据需求上更为灵活,即便在数据较少的环境中也能有效工作。

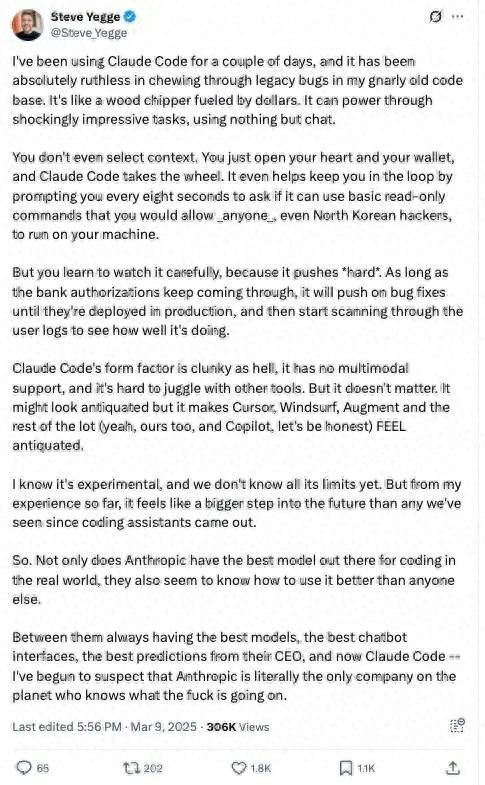

AI大模型由于其强大的能力,适合处理复杂的自然语言任务,如对话生成、翻译和文本理解等。而小模型则更适合于实现边缘计算,处理简单的任务,如语音识别和简单的推荐系统等。

在实时性方面,小模型更加快速,适用于对延迟要求较为严格的应用场景,如手机助手、语音识别等。而大模型由于其庞大的计算需求,通常会有较高的处理延迟。

大模型的训练和维护成本极高,通常需要巨额的资金投入和持续的技术支持。小模型则因其较低的计算和存储需求,能够在较小的预算内实现部署。

大模型在迁移学习方面具备更强的优势,能在特定任务中表现出较高的灵活性和适应性。小模型虽然也可以进行迁移学习,但通常需更加细致的调参和设计。

一般来说,小模型由于其简单性,更容易被理解和解释。而大模型的复杂结构和学习过程,使得其可解释性较差,常常被认为是“黑箱”。

更新大模型通常需要重新进行大规模的训练,耗时耗力。而小模型更新较为频繁,可以通过简单的训练进行快速迭代,保持最新的学习效果。

在职业市场上,开发大模型的需求虽然逐渐增长,但同时也面临着技术复杂性和高门槛的挑战。小模型由于其易用性,培养了一大批“AI小白”,降低了入门门槛。

,随着计算能力的提升和算法的优化,AI大模型将逐渐普及,高级应用场景将不断涌现。小模型也将不断优化,满足更多轻量级应用场景的需求,例如物联网和移动设备中的应用。

AI大模型与小模型各有特色,选择合适的模型需根据具体的应用场景和需求进行权衡。了解它们之间的区别,将助力我们在日益复杂的AI技术环境中做出更明智的决策。希望本文能够为您提供有价值的信息,帮助您在AI领域更进一步。

参考文章:ChatGPT中文版下载与使用指南-手机用户必读的免费资源与注册步骤本文标题:AI大模型与小模型的十大区别-从基础到应用全面解析

网址:https://www.aidamoxing.cn/2024/12/01/2194.html

----------------------------------------------------------------------------------------------------------------------

本站所有文章由ai大模型网通过chatgpt写作修改后发布,并不代表本站及作者的观点;如果无意间侵犯了阁下的权益,请联系我们删除。

如需转载,请在文内以超链形式注明出处,在下将不胜感激!